Si hablamos de la inteligencia artificial en la Criminología, la revolución digital ha transformado tanto el crimen como su investigación. Mientras los delincuentes adoptan tecnologías sofisticadas, las fuerzas de seguridad se enfrentan a un volumen de datos sin precedentes: comunicaciones digitales, imágenes de videovigilancia, transacciones electrónicas y evidencias forenses que crecen de forma exponencial. La inteligencia artificial (IA) emerge como una herramienta prometedora para procesar esta avalancha de información, pero también plantea interrogantes sobre privacidad, sesgos y la propia naturaleza de la justicia.

¿Estamos ante el futuro de la investigación criminal o ante riesgos que podrían socavar las garantías procesales?

Qué aporta La Inteligencia Artificial en la Criminología

Análisis del lenguaje (NLP) para amenazas y radicalización

El procesamiento de lenguaje natural ha revolucionado la forma en que los investigadores analizan comunicaciones masivas. Los algoritmos pueden filtrar automáticamente miles de mensajes, identificando patrones lingüísticos asociados con amenazas, radicalización o grooming infantil.

En casos de cartas de amenaza, la IA puede analizar estilo de escritura, vocabulario y sintaxis para establecer posibles conexiones entre documentos. Herramientas de análisis de sentimientos y detección de emociones permiten identificar escaladas de violencia en redes sociales, mientras que modelos de clasificación ayudan a detectar discurso de odio con más precisión que los métodos tradicionales.

Un ejemplo práctico: el INCIBE (Instituto Nacional de Ciberseguridad de España) ha promovido proyectos piloto de NLP para detectar ciberacoso y fraudes online.

Visión por computador: reconocimiento de patrones y evidencias

La visión artificial ha transformado el análisis de evidencias visuales. Los sistemas pueden procesar miles de fotogramas de videovigilancia en minutos, identificando objetos, rostros o vehículos.

En casos de pornografía infantil, los algoritmos priorizan material sin exponer a los investigadores a contenido traumático. En el análisis balístico, la IA compara marcas de herramientas en proyectiles con bases de datos forenses, acelerando procesos que antes tomaban semanas.

Además, la búsqueda inversa de imágenes asistida por IA permite rastrear la distribución de contenido ilícito, mientras que los algoritmos de super-resolución mejoran la calidad de imágenes degradadas.

Forense digital asistido por IA

El volumen de datos digitales en dispositivos modernos hace inviable el análisis manual exhaustivo. La IA permite priorizar artefactos según su relevancia, agrupar malware mediante clustering y generar líneas de tiempo automatizadas de actividad digital.

En investigaciones financieras, los modelos rastrean transacciones sospechosas a través de múltiples cuentas y jurisdicciones, identificando estructuras de lavado de dinero invisibles al ojo humano. Este tipo de técnicas se conectan directamente con el ámbito del Peritaje Informático y la Cibercriminología, donde la formación especializada resulta clave para su aplicación práctica.

Análisis de redes y grafos para crimen organizado

El análisis de grafos es clave contra el crimen organizado. Los algoritmos pueden mapear relaciones, identificar líderes en base a métricas de centralidad y descubrir rutas de comunicación o financiación.

Estas técnicas han sido utilizadas en operaciones de Europol para desmantelar redes de tráfico de drogas y terrorismo, demostrando la utilidad de combinar criminología clásica con ciencia de datos.

Predicción y prevención: promesas y límites

Modelos predictivos y “hot spots”

Los modelos predictivos anticipan dónde y cuándo es más probable que ocurran delitos, generando “mapas de calor” de criminalidad. Funcionan mejor para delitos recurrentes como hurtos o vandalismo.

Pero la probabilidad nunca equivale a certeza: un 70% de riesgo en una zona no significa que vaya a ocurrir un delito ni quién será el autor. Además, si los datos de entrenamiento tienen sesgos, el modelo los replicará.

Evidencia y validación: métricas que importan

No basta con que un modelo sea “preciso”. En investigación criminal interesan también las tasas de falsos positivos (injusticias por exceso de sospechas) y falsos negativos (delitos que pasan inadvertidos).

En España, la AEPD recuerda que el uso de IA en contextos de seguridad debe ser medible, explicable y auditable.

Riesgos y dilemas éticos

Sesgos algorítmicos y falsos positivos

Los sesgos algorítmicos son el gran reto. Un ejemplo: si los datos policiales históricos están sobrerrepresentados en ciertos barrios, el sistema puede reforzar la estigmatización de esas comunidades.

Mitigar el sesgo requiere datasets diversos, auditorías de equidad y técnicas de explicabilidad. La UE está impulsando regulaciones que exigen estos mecanismos en sistemas de alto riesgo.

Privacidad, proporcionalidad y trazabilidad

El uso de IA plantea riesgos de privacidad si se procesan datos sensibles de ciudadanos no sospechosos. El principio de proporcionalidad exige justificar cada despliegue en función de la gravedad del delito.

La trazabilidad es clave: debe quedar constancia de qué datos se usaron, qué modelo tomó la decisión y bajo qué parámetros. Esto permite la revisión judicial y mantiene la confianza pública.

Marco legal y guías en España/UE

La AEPD (España) establece principios de minimización, transparencia y responsabilidad proactiva en el uso de sistemas de inteligencia artificial. La Comisión Europea, a través de su Reglamento de IA, clasifica los sistemas policiales como de “alto riesgo”, lo que exige supervisión humana y documentación exhaustiva. Por su parte, Europol, CCN-CERT e Interpol recomiendan evaluaciones de impacto, auditorías técnicas y cooperación internacional, aspectos directamente vinculados con la práctica profesional en el ámbito de la Criminalística

Requisitos para implantar La inteligencia artificial en la Criminología con garantías

- Datos de calidad: representativos, actualizados y auditados.

- Equipo multidisciplinar: forenses, científicos de datos, juristas y expertos en ética.

- Auditoría y robustez: pruebas de resistencia y planes de contingencia para fallos.

El factor humano no desaparece

La IA no sustituye al perito ni al analista, sino que amplifica sus capacidades. El criterio humano sigue siendo imprescindible para contextualizar resultados, interpretar anomalías y validar evidencias, lo que refuerza la importancia de la formación especializada en Criminología Aplicada e Investigación Criminal

Mini estudio 2025: percepciones sobre la inteligencia artificial en criminología

La inteligencia artificial (IA) ha dejado de ser un concepto futurista para convertirse en una herramienta cotidiana en ámbitos tan diversos como la medicina, la economía y la seguridad. En el terreno de la investigación criminal, su papel es cada vez más visible: desde sistemas de reconocimiento facial hasta softwares que permiten analizar patrones delictivos, la IA promete transformar la manera en que se previenen y resuelven los crímenes.

Sin embargo, este avance plantea preguntas críticas: ¿qué beneficios aporta realmente? ¿Qué riesgos supone para los derechos fundamentales? ¿Y cómo perciben los futuros criminólogos y profesionales del sector esta revolución tecnológica?

Con el objetivo de aportar respuestas, la Academia Internacional de Ciencias Criminalísticas llevó a cabo en septiembre de 2025 un mini estudio académico entre 95 estudiantes y profesionales vinculados a la criminología y las ciencias forenses.

Objetivo del mini estudio

El propósito fue explorar la percepción que los actores formativos y profesionales tienen sobre la aplicación de la inteligencia artificial en la investigación criminal. A través de cinco preguntas clave, se recogieron opiniones sobre beneficios, riesgos, regulación y el dilema central: ¿es la IA una aliada o una amenaza para la criminología?

Resultados principales

1. La IA como herramienta del futuro inmediato

El 67% de los encuestados cree que la inteligencia artificial será una herramienta clave para la investigación criminal en los próximos cinco años. Un 19% expresó dudas y solo un 14% se mostró escéptico respecto a su relevancia futura.

Este hallazgo confirma que la comunidad académica y profesional ya percibe la IA como un recurso ineludible en la lucha contra el crimen.

2. Beneficios percibidos

Los participantes identificaron los siguientes beneficios principales de la IA aplicada a criminología:

- 54%: Rapidez en el análisis de datos y evidencias.

- 28%: Prevención de delitos mediante la predicción de patrones.

- 18%: Reducción de costes y recursos en investigaciones.

El valor más destacado es la capacidad de la IA para procesar grandes volúmenes de información en menos tiempo, lo que se traduce en investigaciones más ágiles.

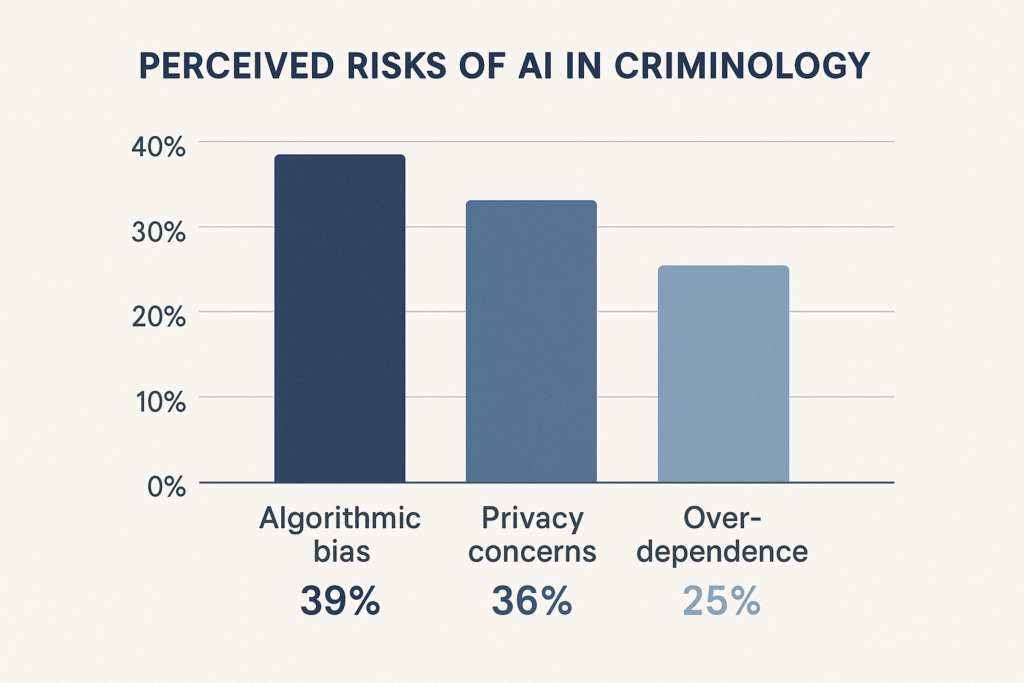

3. Riesgos y preocupaciones

La aplicación de Inteligencia Artificial en criminología no está exenta de riesgos:

- 39%: Sesgos algorítmicos que afecten a minorías.

- 36%: Vulneración de la privacidad ciudadana.

- 25%: Dependencia excesiva de la tecnología frente al criterio humano.

Estos resultados reflejan que la comunidad académica reconoce los riesgos éticos y sociales de delegar funciones críticas a sistemas automatizados.

4. Falta de regulación clara

El estudio reveló que el 72% de los participantes considera que no existe suficiente normativa en España y la Unión Europea sobre el uso de IA en criminalística. Solo un 11% opina que la regulación actual es adecuada, mientras que el 17% no tiene una opinión definida.

La ausencia de un marco jurídico claro genera incertidumbre y abre la puerta a debates urgentes sobre ética, legalidad y derechos fundamentales.

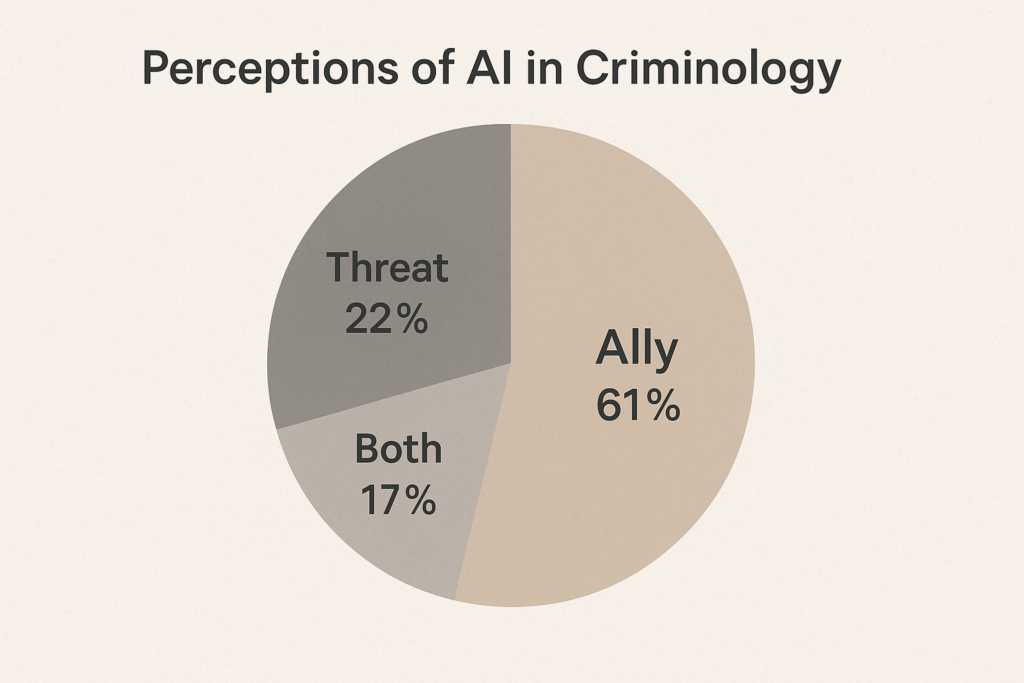

5. ¿Aliada o amenaza?

La pregunta central planteaba si la IA es vista más como un aliado o una amenaza en la investigación criminal:

- 61%: Aliada.

- 22%: Amenaza.

- 17%: Ambas por igual.

Este balance refleja un optimismo prudente: la mayoría reconoce el valor de la IA, pero no ignora los riesgos que conlleva.

Discusión académica

Los resultados muestran un escenario complejo. Por un lado, la IA se percibe como una herramienta transformadora, con capacidad de acelerar procesos y mejorar la eficiencia. Por otro, existen temores legítimos sobre sesgos, vulneraciones de la privacidad y un marco regulatorio aún insuficiente.

Desde un enfoque académico, esta dualidad evidencia la necesidad de:

- Diseñar protocolos éticos claros para el uso de IA en criminología.

- Promover la transparencia en los algoritmos utilizados en investigaciones judiciales.

- Impulsar la formación especializada que prepare a los profesionales para trabajar con estas tecnologías de manera crítica y responsable.

📢 Actualización septiembre 2025: La Academia Internacional de Ciencias Criminalísticas ha publicado una nota de prensa oficial con los resultados de un mini estudio sobre inteligencia artificial en criminología.

Puedes leerla completa aquí

👉 [Nota de prensa: IA en criminología 2025].

Conclusiones

El mini estudio confirma que la IA es vista principalmente como una aliada estratégica en la investigación criminal, aunque con riesgos que no deben subestimarse. La clave estará en equilibrar la innovación tecnológica con la protección de los derechos fundamentales, mediante una regulación sólida y un compromiso ético desde las instituciones.

La Academia Internacional de Ciencias Criminalísticas, a través de este sondeo, busca abrir un espacio de reflexión que impulse tanto el debate académico como la formación de profesionales preparados para afrontar los retos de la criminología en la era digital.

Conclusión

La IA es una herramienta poderosa en la investigación criminal, pero solo si se usa con garantías: supervisión humana, auditorías regulares y respeto estricto a los derechos fundamentales.

El futuro será una colaboración entre personas y máquinas, donde la tecnología amplifique capacidades sin reemplazar la ética ni la responsabilidad humana.

FAQ

¿Puede la la inteligencia artificial en la Criminología sustituir al perito humano en criminología?

No. La IA acelera tareas (búsqueda, triage, patrones), pero no aporta juicio profesional ni contexto. Su rol es asistir: sugiere hipótesis y prioriza evidencias; el perito valida, integra fuentes, evalúa calidad probatoria y rinde cuentas ante el juez. La decisión final debe ser humana, documentada y explicable.

¿Qué sesgos algorítmicos son más frecuentes en IA policial?

Los más comunes: sesgo de representación (datos que no reflejan a toda la población), sesgo de confirmación (refuerza patrones históricos) y sesgo de selección/temporal (muestras desbalanceadas o desactualizadas). Mitigación: datos diversos y auditados, métricas de equidad, validación cruzada por grupos y revisión humana continua.

¿Es legal usar reconocimiento de patrones en España y la UE?

Sí, con límites. El uso debe cumplir RGPD, principios de necesidad y proporcionalidad y, en sistemas de alto riesgo, las exigencias del Reglamento de IA (documentación, supervisión humana, trazabilidad). La identificación biométrica remota en tiempo real en espacios públicos está muy restringida y requiere garantías reforzadas.

¿Qué métricas pedir a un proveedor de IA para investigación criminal?

Además de “precisión”, exige recall, especificidad, FPR/FNR desglosadas por grupos, calibración (que las probabilidades reflejen realidad), curvas ROC/PR, evidencia de auditorías independientes, política de actualizaciones y explicabilidad (qué variables pesan y por qué). Pide también documentación de los datasets y tests adversariales.

¿Cómo documentar decisiones asistidas por la inteligencia artificial en la investigación criminal ante un juez?

Registra: modelo y versión, propósito de uso, datos de entrada, parámetros y salida con niveles de confianza. Conserva logs y cadena de custodia digital. Adjunta métricas de validación, límites conocidos y la supervisión humana aplicada (quién revisó, qué aceptó/rechazó y por qué). La explicación debe ser comprensible para no técnicos.